- Deutsch

-

EnglishDeutschItaliaFrançais한국의русскийSvenskaNederlandespañolPortuguêspolski繁体中文SuomiGaeilgeSlovenskáSlovenijaČeštinaMelayuMagyarországHrvatskaDanskromânescIndonesiaΕλλάδαБългарски езикGalegolietuviųMaoriRepublika e ShqipërisëالعربيةአማርኛAzərbaycanEesti VabariikEuskeraБеларусьLëtzebuergeschAyitiAfrikaansBosnaíslenskaCambodiaမြန်မာМонголулсМакедонскиmalaɡasʲພາສາລາວKurdîსაქართველოIsiXhosaفارسیisiZuluPilipinoසිංහලTürk diliTiếng ViệtहिंदीТоҷикӣاردوภาษาไทยO'zbekKongeriketবাংলা ভাষারChicheŵaSamoa日本語SesothoCрпскиKiswahiliУкраїнаनेपालीעִבְרִיתپښتوКыргыз тилиҚазақшаCatalàCorsaLatviešuHausaગુજરાતીಕನ್ನಡkannaḍaमराठी

Analog-Digital-Wandler (ADC) erklärt, Funktionsprinzipien und Architekturen

Katalog

Erkundung des Analog-Digital-Wandlers (ADC)

Ein Analog-Digital-Wandler oder ADC ist eine elektronische Schaltung, die ein reales analoges Signal in digitale Daten umwandelt.Es ermöglicht das Lesen von Signalen von Sensoren, Audioquellen, Temperaturgeräten, Drucksystemen und anderen analogen Eingängen durch digitale Prozessoren, Mikrocontroller, Speichergeräte und Kommunikationssysteme.

Analoge Signale ändern sich kontinuierlich, während digitale Systeme mit festen Zahlenwerten arbeiten.Aus diesem Grund ist ein ADC erforderlich, um den analogen Eingang zu bestimmten Zeitpunkten zu messen und ihn als digitalen Code darzustellen.Dieser Prozess ermöglicht es elektronischen Systemen, reale Informationen zu analysieren, zu speichern, zu übertragen und zu steuern.

ADCs werden in vielen Anwendungen eingesetzt, darunter industrielle Steuerungen, medizinische Instrumente, Audiogeräte, Datenerfassungssysteme, Kommunikationsgeräte und eingebettete Elektronik.Ihre Leistung hängt nicht nur von der Auflösung und der Abtastrate ab, sondern auch von der Qualität des Eingangssignals, der Referenzspannung, dem Takt, dem Layout und dem umgebenden Schaltungsdesign.Aus diesem Grund versteht man einen ADC am besten als Teil einer vollständigen Signalkette und nicht nur als eigenständige Komponente.

Kernbetriebsprinzip eines ADC

Ein ADC wandelt eine analoge Eingangsspannung in ein digitales Wort um, indem er das Signal durch eine kontrollierte Messkette leitet, die darauf abzielt, Informationen zu behalten und gleichzeitig vorhersehbare Fehlerquellen unter Kontrolle zu halten.In der täglichen Ingenieursarbeit kann man sich einen ADC leichter als eine Abfolge interagierender Designentscheidungen vorstellen als als eine einzelne „Black Box“.Bandbreite, Rauschen, Genauigkeit, Latenz und Leistung stehen am Ende im Widerspruch zueinander, und die wahre Kunst besteht darin, Kompromisse zu finden, die sich auf der Werkbank, in der Produktion und im Feld immer noch einheitlich verhalten.In den folgenden Abschnitten wird diese Kette in Phasen unterteilt und die Mechanismen erläutert, die in der Regel die Ergebnisse in der Praxis dominieren.

Anti-Aliasing und Eingabekonditionierung

Zweck: Reduzieren der Spektralfaltung vor der Probenahme

Vor der Abtastung wird das Eingangsspektrum absichtlich begrenzt, damit Frequenzkomponenten über der Hälfte der Abtastrate (der Nyquist-Frequenz, fs/2) nicht in das Band zurückfallen, das Sie tatsächlich interessiert.Sobald Aliasing auftritt, ist es mathematisch nicht mehr von legitimen In-Band-Inhalten zu unterscheiden, weshalb die Nachbearbeitung es nicht zuverlässig „rückgängig machen“ kann.

Wenn Aliasing auftaucht, sieht es in einer Handlung oft täuschend „echt“ aus: Ausläufer, wo keine Ausläufer zu erwarten waren, Töne, die stabil erscheinen, oder Rauschen, das eine Form zu haben scheint.Diese Erfahrung verändert tendenziell die Art und Weise, wie Menschen das Frontend betrachten, und zwar weniger als eine Formalität, sondern eher als Leitplanke für vertrauenswürdige Messungen.

Praktische Implementierungen und Designentscheidungen

Typische Implementierungen umfassen aktive RC-Filter, passive RC-Netzwerke und Filter mit geschalteten Kondensatoren, die mit dem Abtasttakt synchronisiert sind.Die Wahl wird selten allein durch einen idealen Frequenzgang bestimmt;Dies hängt normalerweise davon ab, wie der ADC-Eingang physisch abgetastet wird und wie fehlerverzeihend die Quelle und der Treiber wirklich sind.

Viele ADCs stellen eine dynamische Eingangslast dar, da regelmäßig ein Abtastkondensator an den Eingang angeschlossen wird.Dieser Schaltvorgang bedeutet, dass der Filter keine statische Last erkennt und der ADC keine perfekt konditionierte Quelle erkennt;Die beiden Phasen beeinflussen sich gegenseitig auf eine Weise, die subtil sein kann, bis sie messbar ist.

Ein Filter kann in der Simulation oder bei alleiniger Messung korrekt aussehen, nach Anschluss an den ADC jedoch eine unzureichende Leistung erbringen, da der Treiber den Abtastkondensator nicht schnell genug stabilisieren kann.Ein häufiger Moment der Erkenntnis ist, dass eine saubere Sinuswellenquelle unerwartete Verzerrungen, kleine codeabhängige Wellen oder Oberwellen erzeugt, die vor dem Anschluss des ADC nicht vorhanden waren.

• Konsolidierte Liste: Was typischerweise die Filterauswahl beeinflusst

• Eingangsabtastmethode und effektive Belastung durch geschaltete Kondensatoren

• Treiberstärke, Quellenimpedanz und Einschwingspielraum über die Frequenz

• Zulässiges Phasenverschiebungs- und Gruppenverzögerungsverhalten für die Anwendung

• Empfindlichkeit gegenüber Komponententoleranzen und Temperaturdrift

• Wie viel Bereinigung ist für die digitale Filterung nach der Überabtastung geplant?

Kompromiss: Bandbreite vs. Einschwingen vs. Phasenverhalten

Eine schärfere Tiefpassreaktion kann Out-of-Band-Energie aggressiver unterdrücken, bringt jedoch oft eine erhöhte Phasenverschiebung, mehr Gruppenverzögerung und eine längere Einschwingzeit mit sich.Diese Nebenwirkungen können zum limitierenden Faktor werden, wenn der Konverter schnell wechselnde Eingänge messen oder Kanäle multiplexen soll.

Für eine präzise Datenerfassung bevorzugen viele Teams letztendlich einen Filter mittlerer Ordnung, der einfach zu steuern ist und sich sauber einschwingt, und stützen sich dann auf Oversampling und digitale Filterung, um verbleibende unerwünschte Komponenten zu reduzieren.Dieser Weg fühlt sich möglicherweise weniger „lehrbuchmäßig“ an, ist jedoch tendenziell ruhiger zu validieren und über die Temperatur- und Produktionsverteilung hinweg einfacher stabil zu halten.

Wiederholbares Verhalten über reale Toleranzen hinweg übertrifft oft die theoretische Schärfe, insbesondere wenn sich die Signalkette beim Kaltstart, beim Heißbaden und nach der Komponentenalterung gleich verhalten muss.

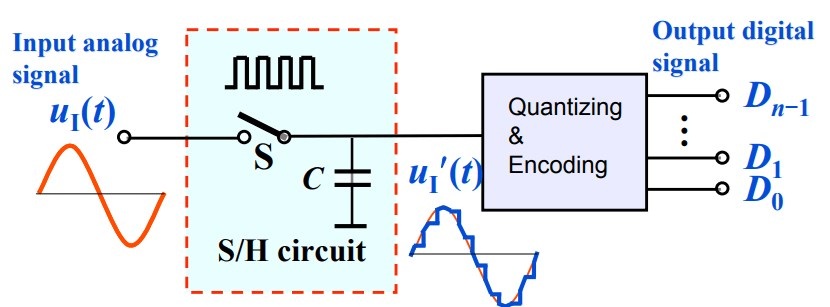

Sample-and-Hold-Betrieb (S/H).

Zweck: Die Eingabe während der Konvertierung ruhig halten

Das Sample-and-Hold-Frontend erfasst den Eingang zu einem definierten Zeitpunkt und speichert ihn auf einem Kondensator, sodass die interne Konvertierungslogik eine stabile Spannung erkennt.Ohne diese Haltefunktion verfolgt der Wandler effektiv einen sich bewegenden Eingang und der Ausgang spiegelt letztendlich sowohl die Amplituden- als auch die Zeitunsicherheit wider.

Wenn sich der Eingang schnell ändert, kann selbst eine kleine Unsicherheit im Abtastzeitpunkt wie zusätzliches Rauschen oder unerwartete Verzerrung aussehen.Das kann bei Hochleistungsdesigns frustrierend sein, da der digitale Ausgang selbst dann ausgelastet erscheint, wenn man davon ausgeht, dass die analoge Quelle sauber ist.

Wichtige Nichtidealitäten und warum sie wichtig sind

Konsolidierte Liste: Die drei Verhaltensweisen, die häufig „Mystery Error“ erklären

• Akquisitionszeit (Einschwingzeit)

• Droop (Leckage halten)

• Blendenjitter (Zeitunsicherheit)

Akquisitionszeit (Eingewöhnungszeit): Wo die Antriebsstärke zum Vorschein kommt

Der Abtastkondensator muss innerhalb des verfügbaren Erfassungsfensters auf den Eingangspegel aufgeladen werden.Wenn der Treiber zu schwach oder die Quellenimpedanz zu hoch ist, stabilisiert sich der Kondensator nicht vollständig und die resultierenden Codes verschieben sich eher voreingenommen als als rein zufälliges Rauschen.

Fehler nehmen häufig mit der Eingangsfrequenz zu und können beim Multiplexen von Kanälen deutlicher sichtbar werden, da der Abtastkondensator zwischen aufeinanderfolgenden Abtastungen weiter „springen“ muss.Dieses Problem tritt häufig auf, wenn ein Kanal für sich genommen ordnungsgemäß funktioniert, die Genauigkeit jedoch abnimmt, wenn die Spannungsdifferenz zwischen den Kanälen größer wird.

Droop (Leckage halten): Kleiner Verfall, echte Konsequenzen

Während der Haltezeit wird der Kondensator durch Leckströme langsam entladen, was zu einem leichten Abfall der gehaltenen Spannung führt.Bei langsameren Konvertern oder in Architekturen, in denen die Konvertierungszeit so lang ist, dass der Abfall nicht mehr vernachlässigbar ist, ist dies tendenziell von größerer Bedeutung.

Blendenjitter: Wenn die Unvollkommenheiten der Uhr zu Spannungsfehlern werden

Die Unsicherheit der Abtastzeit wandelt sich direkt in Spannungsrauschen um, das proportional zur Anstiegsgeschwindigkeit des Eingangs ist.In Hochgeschwindigkeits- und hochauflösenden Szenarien wird dies häufig zum begrenzenden Faktor und kann sich kontraintuitiv anfühlen: Das Hinzufügen nominaler Bits hilft nicht, wenn die Taktunsicherheit das Fehlerbudget dominiert.

Beim Abtasten einer schnellen Sinuswelle kann eine Verbesserung der Taktqualität die effektive Auflösung stärker steigern als der Austausch des ADC, da das durch Jitter verursachte Rauschen abnimmt, obwohl die Bitanzahl im Datenblatt des Wandlers gleich bleibt.

Implikation auf Systemebene: Der Treiber verhält sich wie ein Teil des Konverters

„ADC-Leistung“ bedeutet oft „Front-End-Leistung“.

Bei eingesetzter Hardware hängt die beobachtete ADC-Leistung häufig von der analogen Treiberstufe und nicht nur vom Wandler ab.Wenn sich der Treiber nicht schnell einpendeln und eine geringe Verzerrung im Abtastnetzwerk des ADC aufrechterhalten kann, bleiben die Datenblattzahlen möglicherweise unerreichbar, selbst wenn der ADC technisch korrekt funktioniert.

Konsolidierte Liste: Typische Treiberelemente, die Ergebnisse beeinflussen

• Operationsverstärker- oder Pufferstufen

• Transformatoren

• Sensorschnittstellennetzwerke

• Dedizierte ADC-Treiber oder vollständig differenzielle Verstärker

Wie Teams Überraschungen während der Validierung reduzieren

Ein zuverlässiger Ansatz besteht darin, den Eingangstreiber, den Anti-Aliasing-Filter und S/H als ein kombiniertes Frontend zu behandeln und sie gemeinsam unter Verwendung von Worst-Case-Signalschritten und Temperaturecken zu validieren.Diese Denkweise reduziert tendenziell das Debuggen in der Spätphase, bei dem digitale Daten „falsch aussehen“, die Ursache jedoch in der analogen Einschwingung liegt.

Quantisierung: Zuordnung analoger Werte zu diskreten Codes

Ideales Quantisierungsmodell und LSB-Größe

• Diskrete Entscheidungen auf analoger Ebene

Die Quantisierung ordnet den gehaltenen Analogwert einem von 2^N diskreten Codes für einen N-Bit-ADC zu.Bei einer vollständigen Referenz-Vref beträgt die ideale Codebreite (ein niedrigstwertiges Bit):

LSB = Vref / 2^N

• Fehler existieren auch im idealen Modell

Da Werte zwischen Codegrenzen nicht genau dargestellt werden können, führt die Quantisierung zu einem inhärenten Fehler.Im idealen Modell ist dieser Fehler auf ±0,5 LSB begrenzt.

Praktische Interpretation: Auflösung ist nicht dasselbe wie Genauigkeit

• Zwei Fragen, die in Spezifikationsdiskussionen für Verwirrung sorgen

Die LSB-Größe gibt Auskunft darüber, „wie fein die Schritte sind“, während die Genauigkeit davon abhängt, wie nah die Codeübergangsschwellenwerte an ihren beabsichtigten Positionen liegen und wie stabil sie über die Zeit bleiben.

• Was bei realen Designs oft schief geht

Probleme beginnen oft dann, wenn ein Entwurf nur auf der Bitzahl basiert, während Referenzstabilität, Rauschen und Front-End-Einschwingverhalten als nachträgliche Überlegungen behandelt werden.Das Ergebnis können Ausgabedaten sein, die beeindruckend detailliert aussehen, unter realistischen Betriebsbedingungen jedoch nicht zuverlässig korrekt bleiben.

• Eine stille, aber häufige Quelle der Enttäuschung

Wenn die numerische Ausgabe stabil erscheint, aber je nach Temperatur- oder Lastbedingungen schwankt, handelt es sich normalerweise nicht um eine „digitale Verrücktheit“.Es ist das analoge Ökosystem, das Referenzverhalten, die Kopplung, die Festlegung der Margen, die durch den Codestrom sichtbar sind.

Beispiel (gleiche Werte, klarere Zuordnung)

• Berechnen der Schrittgröße

Mit Vref = 8 V und N = 3, LSB = 1 V.

• Konsolidierte Liste: Ideale Code-Bins

- 0–1 V → 000- 1–2 V → 001

- 2–3 V → 010

- 3–4 V → 011

- 4–5 V → 100

- 5–6 V → 101

- 6–7 V → 110

- 7–8 V → 111

• Was „Umschalten in der Nähe einer Grenze“ normalerweise bedeutet

In Testaufbauten wechseln Werte in der Nähe eines Übergangs (z. B. nahe 3,0 V) häufig zwischen benachbarten Codes, wenn Eingangsrauschen, Referenzrauschen oder Jitter vorhanden sind.Dieses Umschalten ist nicht automatisch ein Defekt;Es ist häufig ein ehrlicher Indikator dafür, dass das gesamte Systemrauschen in der Größenordnung eines Bruchteils eines LSB liegt.

Kodierung und digitale Ausgabebereitstellung

Von der internen Entscheidung zu nutzbaren Daten

• Eine Codeauswahl in ein transportables Wort umwandeln

Nach der Quantisierung gibt die Codierung den ausgewählten Code als Binärwort oder serialisierten Bitstrom aus.Dieser Schritt scheint bis zum Beginn der Integration oft einfach zu sein, da die Schnittstellendetails Timing, Latenz und Datenintegrität auf eine Weise beeinflussen, die Software allein nicht immer überdecken kann.

• Konsolidierte Liste: Allgemeine Überlegungen zur Integration

- Ausgabeformat: gerades Binärformat, Zweierkomplement, Offset-Binärformat

- Schnittstellentyp: SPI, parallel, LVDS, JESD204

- Systemeinschränkungen: Timing-Abschluss, Latenzbudgetierung, Datenintegrität und Bitfehlerempfindlichkeit

- Probleme mit mehreren Takten: Taktdomänenübergänge und Synchronisationsstrategie

- Layout-Realitäten: Erdung, Rückstrompfade und Signalintegrität

• Wo aus „ADC-Debugging“ „Digital Debugging“ wird

In vielen Systemen ist die Konvertierung selbst in Ordnung, aber Wechselwirkungen zwischen der Taktdomäne, Erdungsoptionen oder ein marginales Schnittstellen-Timing führen zu Symptomen, die wie analoges Rauschen aussehen.Dies kann eine demütigende Phase eines Projekts sein, da die Lösung möglicherweise eher im Routing, in der Terminierung oder in der Clock-Tree-Disziplin als in den ADC-Einstellungen liegt.

Praktischer Einblick: Digitale Sauberkeit bewahrt analoges Verhalten

• Digitales Rauschen kann nach hinten dringen

Auch wenn Codierung und Transport digital erfolgen, können ein schlechtes Layout oder verrauschte digitale Rückströme in das analoge Frontend einkoppeln und die effektive Leistung beeinträchtigen.

• Worauf sich erfahrene Layout-Rezensionen normalerweise konzentrieren

Durch die Trennung von Rückwegen, wo es angebracht ist, die Kontrolle der Impedanz dort, wo es wirklich darauf ankommt, und die Anwendung einer disziplinierten Erdungsstrategie lässt sich oft ein messbares ENOB wiederherstellen.Dies kann in der Praxis zufriedenstellend sein, da es das native Verhalten der Hardware verbessert, anstatt sich auf nachgeschaltete Filterung zu verlassen, um Schwachstellen zu verbergen.

Reale Abweichungen von der idealen Transferkurve

Begriffe zu schwerwiegenden Fehlern

• Konsolidierte Liste: Häufige Abweichungen von der Übertragungskurve

- Offsetfehler: eine nahezu konstante Verschiebung der Übertragungskurve

- Verstärkungsfehler: ein Steigungsfehler, der die Ausgabe relativ zum Ideal skaliert

- Integrale Nichtlinearität (INL): Abweichung der tatsächlichen Übertragungsfunktion von einer Geraden

- Differenzielle Nichtlinearität (DNL): Abweichung jeder Codebreite von 1 LSB;Große DNLs können zu fehlenden Codes führen

• Wie diese außerhalb eines Datenblatts angezeigt werden

Offset- und Verstärkungsfehler fühlen sich oft „beherrschbar“ an, weil sie wie globale Verschiebungen aussehen, während sich INL/DNL hartnäckiger anfühlen können, weil sie die Form der Übertragungsfunktion verzerren und je nach Code und Betriebsbedingungen geringfügig variieren können.

Warum diese Fehler in der Praxis von Bedeutung sind

• Zuordnung von Fehlertypen zu Anwendungsproblemen

Diese Nichtidealitäten beeinflussen, ob sich ein ADC für Präzisionsmessungen, Regelkreise oder Spektralanalysen gut verhält.Offset- und Verstärkungsfehler können häufig durch Kalibrierung korrigiert werden, während INL/DNL und rauschähnliche Effekte (Jitter, thermisches Rauschen, Referenzrauschen) tendenziell Grenzen setzen, die durch die Kalibrierung nicht aufgehoben werden.

• Eine fundierte Sicht auf die Kalibrierung

Durch die Kalibrierung können systematische Verschiebungen korrigiert werden, sie beseitigt jedoch nicht zuverlässig Verzerrungsmechanismen oder instabile Schwellenwerte.Ein häufiges Ergebnis ist, dass die Kalibrierung am besten funktioniert, wenn das System bereits stabil ist.

Kernmeinung: Ein ADC verhält sich wie ein System, nicht wie eine einzelne Spezifikationslinie

• Warum „N Bits bei fs“ zu viel weglässt

Wenn man einen ADC nur als „N Bits bei fs Samples pro Sekunde“ beschreibt, werden die Einschränkungen übersehen, die darüber entscheiden, wie viele nutzbare Informationen man tatsächlich erhält.Die gesamte Kette prägt das Ergebnis: Anti-Aliasing-Filterung, Antrieb und Einschwingen in den S/H, Taktintegrität, Referenzverhalten und Konverterlinearität.

• Konsolidierte Liste: Was normalerweise die nutzbare Leistungsobergrenze festlegt

- Verhalten des Anti-Alias-Filters unter realer Belastung

- Einschwingen und Verzerrung des Treibers im Abtastnetzwerk

- Taktjitter und Verteilungsqualität

- Referenzrauschen, Drift und Kopplungspfade

- INL/DNL-Verhalten über alle Codes und Temperaturen hinweg

• Was eine starke Feldleistung normalerweise gemeinsam hat

Systeme, die sich außerhalb des Labors gut verhalten, sind in der Regel diejenigen, bei denen Einschränkungen frühzeitig berücksichtigt, mit realistischen Reizen (Schritte, Mehrtonsignale, Temperaturdurchläufe) validiert und durch Iteration im Front-End verbessert wurden, anstatt zu versuchen, das Problem „später zu beheben“, sobald das digitale Ausgabeformat und der Integrationsplan bereits festgelegt sind.

ADC-Architekturtypen und wo sie am besten passen

ADC-Architekturen werden häufig danach gruppiert, was genau quantisiert wird.

Direkt-ADCs übersetzen eine Eingangsspannung direkt in einen digitalen Code, indem sie diese Spannung mit Referenzpegeln vergleichen.

Indirekte ADCs gehen einen eher umständlichen Weg: Sie wandeln zunächst die Spannung in eine Zwischengröße um, häufig Zeit, Ladung oder Frequenz, und digitalisieren dann dieses Zwischenergebnis.

Dieser Unterschied wird im realen Test deutlich.Erdungsstörungen, Referenzdrift aufgrund der Temperatur, Taktphasenrauschen und Störungen durch Stromleitungen können den Signalpfad beeinträchtigen.Unter diesen Bedingungen bestimmt die Wahl zwischen direkter und indirekter Konvertierung häufig die Art der Fehler, die beim Debuggen auftreten.Die ADC-Architektur beeinflusst mehr als nur Datenblattspezifikationen, da sie auch bestimmt, welche Fehler reduziert werden und welche sichtbar bleiben.

Indirekte Methoden tauschen normalerweise Durchsatz gegen Stabilität aus.Durch Integrieren, Akkumulieren oder Zählen über die Zeit glätten sie Breitbandrauschen auf natürliche Weise und können periodische Störungen stark unterdrücken.Dieses Verhalten wirkt beruhigend in Systemen, in denen die Genauigkeit über Sekunden und Minuten hinweg gleich aussehen muss, nicht nur über Mikrosekunden.

Direkte Methoden hingegen basieren auf einer schnellen Entscheidungsfindung.Ihr praktischer Reibungspunkt ergibt sich eher aus dem Einschwingen der Referenz, der Komparatorunsicherheit und der Integrität des Eingabeabtastprozesses als aus der langfristigen Mittelung.

Eine hilfreiche Möglichkeit, direkte ADC-Familien zu definieren, besteht darin, zwei Fragen zu stellen: Wie viele Vergleiche finden pro Probe statt und wie viele Schaltkreise werden repliziert, um dies zu ermöglichen.Flash, SAR und andere direkte Stile führen zu unterschiedlichen Antworten, und diese Antworten führen zu unterschiedlichen Ausgabenmustern in Bezug auf Siliziumfläche, Leistung, Latenz und Rauschbudget.Moderne Systeme bauen auch auf diesen Ideen mit Pipelines (gestufte Quantisierung mit hohem Durchsatz) und Sigma-Delta-Ansätzen (Oversampling mit Noise Shaping) auf, meist weil ein Team versucht, einen bestimmten Geschwindigkeits-Präzisions-Punkt zu erreichen, ohne spät im Zeitplan zu entdecken, dass der „einfache“ Knopf tatsächlich drei andere Knöpfe gleichzeitig bewegt.

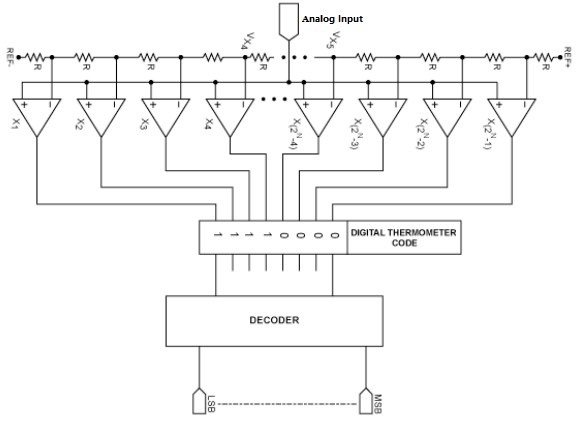

• Flash-Konverter: viele Vergleiche auf einmal, mit doppelter Hardware und passenden Problemen.

• SAR-Konverter: Ein Komparator wird in einer Folge von Vergleichen wiederverwendet, wobei die Konvertierungszeit mit der Auflösung zunimmt.

• Dual-Slope-Konverter: Die Amplitude wird in ein zeitgesteuertes Intervall umgewandelt, das mit einer Uhr gezählt werden kann, mit starker Stabilität und Interferenzunterdrückung, aber langsameren Aktualisierungen.

• Pipeline-Architekturen: abgestufte Quantisierung mit dem Ziel eines hohen Durchsatzes.

• Sigma-Delta-Architekturen: Oversampling plus Noise Shaping mit dem Ziel einer hohen Präzision innerhalb einer Bandbreite.

Flash ADC (vollparallele Konvertierung)

Ein Flash-ADC schließt eine Konvertierung im Wesentlichen in einem einzigen Entscheidungsereignis ab, indem er die Eingabe parallel mit einer Reihe von Schwellenwerten vergleicht.Ein N-Bit-Flash verwendet normalerweise 2^N − 1 Komparatoren, eine Referenzleiter (häufig eine Widerstandskette oder ein entsprechendes Netzwerk) und einen Encoder, der Komparatorausgänge im Thermometerstil in ein Binärwort umwandelt.Da alle Vergleiche gleichzeitig erfolgen, bleibt die Latenz extrem niedrig und die Auflösung wird nur schwach verfolgt.Aufgrund dieser Eigenschaft fühlen sich Flash-Designs in sehr breitbandigen Abtastketten, schnellen Regelkreisen und Hochgeschwindigkeits-Kommunikationsempfängern, bei denen Verzögerungen schmerzhaft sichtbar sind, fast „mühelos“ an.

Die Rechnung wird als exponentielles Hardware-Wachstum fällig.Jedes hinzugefügte Bit verdoppelt nahezu die Anzahl der Komparatoren, was sich in einer größeren Chipfläche, höherer Leistung und mehr Eingangskapazität für die Signalquelle niederschlägt.In der Praxis ist diese Eingangsbelastung keine abstrakte Spezifikation mehr, sondern wird zu einer Einschränkung auf Platinenebene: Stärkere Treiber, sorgfältige Terminierung und kurze Routings mit kontrollierter Impedanz machen oft den Unterschied zwischen einem sauberen Hochfrequenzeingang und einem auf mysteriöse Weise dumpfen oder verzerrten Eingang aus.

Nichtübereinstimmung ist eine weitere unvermeidbare Flash-Realität.Bei so vielen Komparatoren ist die Offset-Variation kein Einzelfall;Bei höheren Auflösungen wird es zum normalen Betriebszustand.Wenn keine Kalibrierung erfolgt, werden Nichtübereinstimmungen als Codefehler angezeigt.Wenn die Kalibrierung hinzugefügt wird, werden die Komplexität der Kalibrierung und das Startverhalten Teil der Persönlichkeit des Systems, etwas, das das umfassendere Design tolerieren und nicht ignorieren muss.Daher belassen Teams Flash in der Regel in einem Bereich, in dem die Bandbreite das Gespräch dominiert und die Auflösung bescheiden bleiben kann, da der Versuch, eine hohe Auflösung ausschließlich über vollparallele Hardware zu erzwingen, eher wie die Zahlung von Zinseszinsen wirkt.

Eine praktische Nuance besteht darin, dass die Flash-Leistung selten nur vom Komparator-Array bestimmt wird.Sobald die Abtastraten steigen, sind Referenzverteilung, Encoder-Metastabilität und Substratrauschkopplung oft die eigentlichen Problemquellen.Designs, die sich gut behaupten, neigen dazu, das Referenznetzwerk und die digitale Schaltumgebung als analoge Probleme mit analogen Konsequenzen zu behandeln, nicht als „nur digitale“ Implementierungsdetails, die später bereinigt werden können.

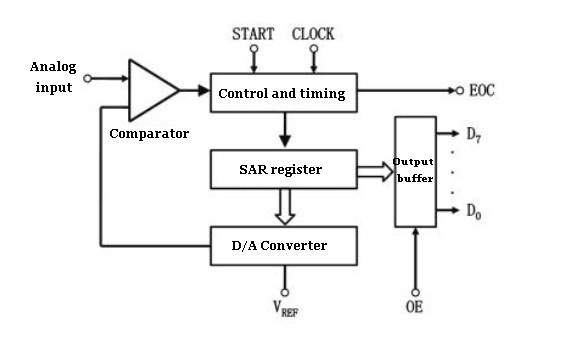

Sukzessiver Approximationsregister-ADC (SAR ADC)

Ein SAR-ADC digitalisiert, indem er eine binäre Suche mit einem Komparator, einem Sample-and-Hold-Netzwerk und einem internen DAC durchführt, üblicherweise einem kapazitiven DAC, da er eine gute Anpassung mit geringer statischer Leistung verbindet.Nach dem Abtasten des Eingangs legt die SAR-Logik vorläufig das MSB fest, der DAC erzeugt eine Testspannung und der Komparator entscheidet, ob der abgetastete Eingang über oder unter diesem Test liegt.Die Entscheidung wird beibehalten, das nächste Bit wird getestet und dies wird wiederholt, bis alle N Bits aufgelöst sind.

Durch die Wiederverwendung eines Komparators und eines DAC bleiben Fläche und Leistung bei gleicher Auflösung weit unter einem Flash-ADC.SAR-Wandler lassen sich auch problemlos in Mixed-Signal-Designs integrieren, da ihre digitale Logik kompakt ist und ihr Abtastverhalten genau gesteuert werden kann.Für viele eingebettete Sensoren und Datenerfassungspfade scheint SAR am Ende die am wenigsten dramatische Option zu sein: genug Auflösung, um echte Messungen darzustellen, genug Geschwindigkeit für Überwachung und Steuerung und Leistung, die keinen Streit über die Batterielebensdauer auslöst.

Die Konvertierungszeit nimmt ungefähr mit N zu, da pro Bit ein Vergleich durchgeführt wird, zuzüglich der für den DAC und den Komparator benötigten Einschwingzeit.Diese Skalierung wird beim Hochfahren deutlich spürbar.Wenn ein Team die Abtastrate erhöht und fehlende Codes oder Verzerrungen feststellt, liegt die Ursache häufig nicht in der SAR-Zustandsmaschine;Es handelt sich um eine unvollständige Einschwingzeit des DAC oder um eine unzureichende Erfassungszeit für den Abtastkondensator.Die Fähigkeit zur Eingabe von Laufwerken ist eine häufige „stille Einschränkung“.Eine kleine Wahl, die harmlos aussieht, wie zum Beispiel ein größerer Vorwiderstand zum Schutz, kann den Ladevorgang des Abtastnetzwerks verlangsamen und bei höheren Eingangsfrequenzen zu Verstärkungsfehlern oder harmonischen Verzerrungen führen.Gruppen, die durchweg eine vorhersehbare Leistung erzielen, planen die Erfassungszeit in der Regel explizit ein und überprüfen sie anhand der Worst-Case-Quellenimpedanz, Temperatur und Referenztoleranz, anstatt sich auf Nominalwerte zu verlassen.

Die limitierenden Faktoren, die viele SAR-Designs dominieren, sind konkret und überprüfbar:

• DAC-Einschwingverhalten und Linearität.

• Komparatorgeräusch und Rückschlag.

• Referenzstabilität unter dynamischer Belastung.

• Clock-Jitter-Effekte bei abgetasteten Eingängen.

Eine Designgewohnheit, die Überraschungen tendenziell reduziert, besteht darin, die Referenz als eigene analoge Versorgungsschiene zu behandeln, komplett mit diszipliniertem Routing, Entkopplung und Transientenanalyse.Durch die SAR-Umwandlung wird die Ladung bei jedem Bitversuch zurück in die Referenz geleitet, und diese Rückkopplung kann im Labor emotional entkräften, wenn sie sich als „zufälliges“ Rauschen tarnt, bis schließlich jemand den Referenzstift richtig prüft.

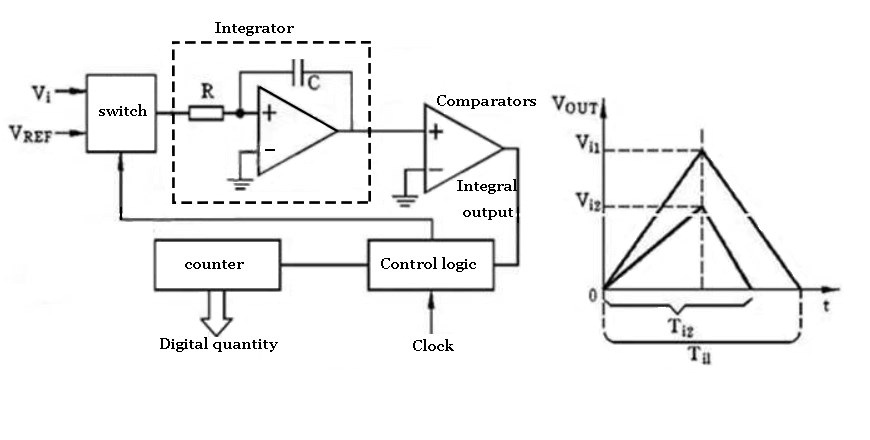

Dual-Slope-ADC (integrierende, zeitbasierte Umwandlung)

Ein Dual-Slope-ADC wandelt Spannung in Zeit um.Es integriert den Eingang für ein festes Intervall und integriert dann eine Referenz mit entgegengesetzter Polarität, bis der Integratorausgang auf Null zurückkehrt.Die Dauer dieser zweiten Phase (Deintegration) ist proportional zum durchschnittlichen Input während der ersten Phase.Ein Zähler misst das Desintegrationsintervall mithilfe einer stabilen Uhr und der Zählerstand wird in den digitalen Ausgang umgewandelt.

Der Reiz besteht darin, dass die Integration auf natürliche Weise eine Mittelwertbildung durchführt.Zufälliges Rauschen nimmt mit dem Mittelungsfenster ab und periodische Störungen können stark unterdrückt werden, wenn die Integrationszeit auf ein ganzzahliges Vielfaches der Netzperiode abgestimmt ist.

Beispiele für übliche netzsynchrone Fenster: 20 ms für 50 Hz, 16,67 ms für 60 Hz oder ganzzahlige Vielfache davon.

Aus diesem Grund haben Dual-Slope-Wandler in Präzisionsinstrumenten wie Digitalmultimetern eine lange Tradition: Sie bleiben auch dann stabil, wenn die Messumgebung elektrisch unordentlich ist.Auf Labortischen und in Feldgehäusen spart die Möglichkeit, Leitungsbrummen ohne komplizierte Filterung zu unterdrücken, oft mehr Zeit bei der Entwicklung als das Streben nach geringfügigen Verbesserungen der Rohauflösung.

Der Kompromiss ist die Reaktionsfähigkeit.Sowohl die Integration als auch die Deintegration nehmen Echtzeit in Anspruch, und Konvertierungen dauern üblicherweise Millisekunden oder länger.Aufgrund dieser Realität eignet sich Dual-Slope nicht für sich schnell ändernde Signale, eine strenge Regelung oder die Erfassung breitbandiger Wellenformen.Es leuchtet, wenn sich die Signale langsam bewegen und das Ziel ein verlässlicher Durchschnitt ist.In der Praxis ist die Dual-Slope-Genauigkeit nicht nur eine Integratorgeschichte;Dies hängt von der Referenzstabilität, dem dielektrischen Verhalten des Kondensators, den Leckströmen und dem Zeittakt ab.Gut ausgeführte Designs wählen Komponenten und Zeitfenster aus, die diese Fehlerquellen vorhersehbar halten, und akzeptieren die langsamere Aktualisierungsrate als praktische Kosten für Messungen, die auch bei Temperaturschwankungen und elektrischen Störungen konstant bleiben.

Aus einer breiteren Perspektive geht es bei Dual-Slope weniger um den Gewinn eines „hochauflösenden“ Marketingwettbewerbs als vielmehr um die Wahrung der Messintegrität.Wenn dem Systembesitzer eigentlich Wert auf Wiederholbarkeit und Störfestigkeit geht, ist die Aufwendung zusätzlicher Zeit für die Integration oft der einfachste Weg zum Vertrauen.

Technische Parameter des ADC

Die ADC-Fähigkeit wird oft auf „Genauigkeit und Geschwindigkeit“ reduziert, doch die eigentliche Auswahl hängt in der Regel davon ab, was passiert, wenn der Wandler in eine vollständige Signalkette eingebettet ist.Front-End-Bandbreite, Sampling-Dynamik, Referenzreinheit, Taktverhalten, Schnittstellen-Timing und PCB-Implementierungsdetails können das endgültige Messergebnis stillschweigend dominieren.Ein disziplinierter Arbeitsablauf besteht darin, Anwendungserwartungen in Parameter umzuwandeln, die vor Ort gemessen und in einer Designprüfung verteidigt werden können.

Anforderungen im Listenstil, die sich gut in ADC-Kriterien umsetzen lassen:

- Kleinste sinnvolle Signaländerung- Maximaler Signalfrequenzinhalt

- Zulässige Latenz (Kontrolle der Reaktionsfähigkeit vs. Pufferverzögerung)

- Budget für Prozessor-/FPGA-Bandbreite, Speicher und Firmware-Service

Genauigkeit: Die nominale Auflösung ist ein erster Hinweis, keine Garantie

Die Auflösung beschreibt, wie viele unterschiedliche Ausgabecodes der ADC erzeugen kann.Ein idealer N-Bit-Konverter liefert 2^N Codes, was die ideale LSB-Größe impliziert:

LSB = Full-Scale Range / 2^N

Beispiel: mit einem 8-Bit-ADC über einen 5-V-Bereich, LSB ≈ 5 V / 256 = 19,53 mV.

Bei der Einarbeitung ins Labor ist es üblich, optimistisch zu sein, was „noch ein bisschen“ angeht, bis die ersten Rauschdiagramme und Histogramme zurückkommen.Wenn sich eingangsbezogenes Rauschen und Referenzrauschen über mehrere LSBs erstrecken, sieht eine zusätzliche nominale Auflösung auf dem Papier tendenziell gut aus, führt aber kaum zu einer Verbesserung der tatsächlichen Granularität.Der unangenehme (aber nützliche) Aspekt ist, dass der Vorstand oft entscheidet, wie viele Bits Sie tatsächlich behalten dürfen.

Fehlerbegriffe, die die tatsächliche Genauigkeit bestimmen (über die Hauptspezifikation hinaus)

In Datenblättern kann der „Konvertierungsfehler“ als Worst-Case-Abweichung von einer idealen Übertragungsfunktion zusammengefasst werden, typischerweise ausgedrückt in LSB.Diese Zahl ist das kombinierte Ergebnis mehrerer Mechanismen und es hilft, sie zu trennen, da sie sich je nach Kalibrierung, Temperatur und Zeit unterschiedlich verhalten.

• Offset-Fehler

Der Offsetfehler verschiebt die gesamte Übertragungskurve nach links oder rechts.Auf dem Prüfstand zeigt es sich sofort: Ein geerdeter Eingang, der den Code Null ergeben sollte, erzeugt einen Messwert ungleich Null.Viele Teams können dies problemlos mit einer Einpunktkalibrierung beim Start oder während des Produktionstests korrigieren, solange die Offset-Drift über die Temperatur innerhalb der Erwartungen bleibt und keine häufige Neukalibrierung erforderlich macht.

• Verstärkungsfehler

Verstärkungsfehler verändern die Steigung der Übertragungskurve.Nachdem der Offset korrigiert wurde, wird der Verstärkungsfehler offensichtlicher: Die Messwerte können in der Nähe von Null gut aussehen, in der Nähe des Vollausschlags jedoch nach oben oder unten driften.Die Zweipunktkalibrierung (nahe Null und nahezu Vollausschlag) ist ein typischer feldfreundlicher Ansatz, der die meisten Offset- und Verstärkungsfehler beseitigt, während das tiefere Linearitätsverhalten weitgehend unverändert bleibt.Dieses Problem lässt sich oft leichter beheben, da der Verstärkungsfehler normalerweise angepasst werden kann, ohne das analoge Frontend neu zu gestalten.

• INL (Integrale Nichtlinearität)

INL beschreibt die Abweichung der Transferkurve von einer idealen Geraden über den gesamten Bereich.Es zeigt sich, wenn die Anwendung auf konsistente Proportionalität angewiesen ist, wie z. B. Sensorlinearisierung, Regelkreise oder Wellenformmessung, bei der es auf Formtreue ankommt.Eine praktische Enttäuschung besteht darin, dass eine einfache Zweipunktkalibrierung ein INL-Problem nicht „begradigt“.Wenn die INL über das hinausgeht, was das System tolerieren kann, sind typische Optionen:

- Wählen Sie einen Wandler mit besserem Linearitätsverhalten- Reduzieren Sie den Eingabebereich oder zentrieren Sie ihn neu, damit das System in einem lineareren Bereich arbeitet

- Anwenden einer digitalen Korrektur mithilfe einer Charakterisierungstabelle (mit der damit verbundenen Testzeit und dem Wartungsaufwand)

• DNL (Differenzielle Nichtlinearität) und fehlende Codes

DNL misst, wie nahe jede Codebreite an 1 LSB liegt.Wenn die DNL zu hoch ist, kann das System Sticky Codes oder fehlende Codes anzeigen, was besonders bei Messungen auf niedriger Ebene und bei Codedichte- oder Histogramm-basierten Analysen entmutigend sein kann.In der Produktion werden Histogrammtests häufig verwendet, um das Verhalten bei fehlendem Code frühzeitig zu erkennen, da eine Oszilloskopkurve, die „sauber genug aussieht“, immer noch Codeverteilungsfehler maskieren kann.

Effektive Auflösung (ENOB) und das Rauschen, mit dem Sie tatsächlich leben

Eine ehrlichere Aussage zur Genauigkeit ist: Wie viele Bits sind in der realen Baugruppe verwendbar?Thermisches Rauschen, Referenzrauschen, Quantisierungsrauschen und digitale Kopplung reduzieren die effektive Anzahl von Bits (ENOB), oft aggressiver bei höheren Eingangsfrequenzen.Auf Mixed-Signal-Boards macht man häufig und leicht schmerzhaft die Entdeckung, dass digitale Aktivitäten (schnelle GPIO-Kanten, serielle Hochgeschwindigkeitsbusse, Schaltregler) das Grundrauschen erhöhen, bis sich der ADC so verhält, als ob er weniger Bits hätte, als in der Überschrift des Datenblatts angedeutet wird.Die Beachtung der Rückströme, der Erdungsstrategie und der Referenzführung führt häufig zu messbareren Verbesserungen als der Wechsel zu einem etwas „besseren“ ADC-Modell.

Rausch- und Kopplungsfaktoren im Listenstil, die sich häufig auf ENOB auswirken:

- Thermisches Rauschen (Front-End-Widerstände, Verstärker, Sensorquellenimpedanz)- Referenzrauschen und Referenzimpedanz

- Quantisierungsrauschen und Aperturunsicherheit (frequenzabhängig)

- Digitale Kopplung über Masse-/Rückleitungspfade und Versorgungsschienen

- EMI-Aufnahme durch hochohmige Knoten und lange Leiterbahnen

Geschwindigkeit: Konvertierungszeit, Durchsatz und Latenz als separate Fragen

Geschwindigkeit wird oft als Konvertierungszeit beschrieben: die Verzögerung von der Abtastung (oder dem Beginn der Konvertierung) bis zu einem gültigen Ausgabecode.Welche Metrik ausschlaggebend ist, hängt von der Persönlichkeit des Systems ab: Regelkreise kümmern sich um Latenz und Determinismus, während Record-and-Stream-Systeme sich um dauerhaften Durchsatz und Pufferung kümmern.

Architekturbedingte Geschwindigkeitsunterschiede

Die Konvertierungszeit variiert erheblich je nach ADC-Architektur, und die Kompromisse treten schnell zutage, sobald die Einschränkungen des analogen Frontends und des Layouts berücksichtigt werden.

• Flash-ADC

Flash-Konverter können Konvertierungen in wenigen Nanosekunden oder weniger durchführen.Sie eignen sich für extreme Bandbreitenszenarien, wenn Leistung und Kosten akzeptabel sind.Bei der alltäglichen Hardware-Arbeit sind die Layout-Disziplin und die Stärke des Eingabe-Drives die Hauptsorgen, da sich das Front-End außergewöhnlich schnell einpendeln muss und Parasiten keine „kleinen Details“ mehr sind.

• SAR (Successive Approximation Register) ADC

SAR-ADCs liegen oft im praktischen Mittelband, von Mikrosekunden bis hin zu Hunderten von Nanosekunden in leistungsstärkeren Teilen.Sie führen auch zu einer allgemeinen Einschränkung in der realen Welt: Der Eingang wird typischerweise von einem Netzwerk mit geschalteten Kondensatoren abgetastet.Die Signalquelle muss den Abtastkondensator innerhalb des Erfassungsfensters laden, oder das Design muss einen Pufferverstärker und/oder ein RC-Netzwerk hinzufügen.Viele Probleme, die zunächst wie „ADC-Nichtlinearität“ aussehen, stellen sich zum Zeitpunkt der Abtastung als unvollständige Beruhigung heraus, was ärgerlich sein kann, bis der Erfassungszeitpunkt und die Quellenimpedanz notiert und überprüft sind.

• Dual-Slope (integrierender) ADC

Dual-Slope-ADCs benötigen in der Regel zehn bis hunderte Millisekunden pro Wandlung und können bei entsprechender Konfiguration eine starke Unterdrückung periodischer Störungen (insbesondere 50/60 Hz) bieten.Sie werden häufig für langsame, hochpräzise instrumentelle Messungen ausgewählt, bei denen Latenz toleriert wird und Wiederholbarkeit im Vordergrund steht.

Die Abtastrate muss zur Bandbreite und zum Einschwingverhalten passen

Die Wahl von „Samples pro Sekunde“ ist nicht nur eine Nyquist-Übung.Das analoge Frontend muss sich vor dem Abtastereignis auf die erforderliche Genauigkeit einstellen.Wenn das Ziel beispielsweise eine Einschwingzeit von 0,5 LSB in einem hochauflösenden System ist, kann die Einschwingzeit zum begrenzenden Faktor werden, selbst wenn der ADC-Kern schnell genug ist.Eine verlässliche Designgewohnheit besteht darin, das gesamte Eingabenetzwerk als Teil des Zeitbudgets zu behandeln und nicht als etwas, das „später optimiert“ werden muss, da Überraschungen bei der Abwicklung in der Spätphase tendenziell überstürzte, unangenehme Nacharbeiten auslösen.

Listenartige Elemente, die zum Abrechnungs-/Terminbudget gehören:

- Sensorausgangsimpedanz und etwaiges Schutznetzwerk- Anti-Alias-Filterkomponenten und ihre Zeitkonstanten

- Multiplexer-Einschaltwiderstand und Ladungsinjektionsverhalten

- Bandbreite, Anstiegsgeschwindigkeit und Wiederherstellung des Pufferverstärkers

- Eigenschaften des ADC-Erfassungsfensters und des Abtastkondensators

Eingangsbereich, Polarität und Front-End-Bandbreite (Wie der ADC das reale Signal trifft)

Eingangsbereich und Polarität, unipolar vs. bipolar, single-ended vs. differentiell, definieren, wie sich der ADC an die Signalumgebung anpasst.Differenzeingänge können die Empfindlichkeit gegenüber Gleichtaktrauschen verringern und die Robustheit in elektrisch verrauschten Umgebungen verbessern, sie erfordern jedoch auch eine sorgfältige Überprüfung der Gleichtaktgrenzen, des Verstärkerausgangshubs und des Eingangsschutzverhaltens.

Die Front-End-Bandbreite wird oft unterschätzt.Selbst wenn das interessierende Signal „langsam“ ist, können schnelle Flanken, Interferenzen oder Multiplex-Abtastung eine große Bandbreite erfordern, sodass sich das Signal schnell und vorhersehbar einpendelt.Bei gemultiplexten Kanälen können Memory-Effekte von Kanal zu Kanal und Ladungsteilung die Messwerte verfälschen, es sei denn, das Netzwerk ist für die Wiederherstellung zwischen Proben ausgelegt;Wenn dies zum ersten Mal auftritt, kann es sich anfühlen, als ob das System „heimgesucht“ wird, aber um ehrlich zu sein, liegt es normalerweise nur an der Ladungsdynamik.

Referenzspannung: Der Stabilitätsanker hinter jedem Code

Die Referenz definiert den Maßstab jedes Ausgabecodes und ihr Verhalten bestimmt oft, ob die Kalibrierung über Temperatur und Zeit hinweg sinnvoll bleibt.Wenn die Referenz schwankt oder durch Platinenrauschen verschmutzt wird, kann der ADC inkonsistent aussehen, selbst wenn sich der Wandler selbst wie angegeben verhält.

Interne vs. externe Referenz

Interne Referenzen reduzieren die Anzahl der Komponenten und vereinfachen die Integration, können jedoch ein höheres Rauschen oder eine höhere Drift aufweisen als präzise externe Referenzen.Externe Referenzen können die Stabilität verbessern, wenn Routing, Entkopplung und thermische Platzierung richtig gehandhabt werden.In praktischen Designs kann die Platzierung der Referenz in der Nähe des ADC, die Verwendung eines sauberen Rückwegs und die Trennung von schnellen digitalen Strömen genauso wichtig sein wie die Spezifikationen im Datenblatt.

Drift, Lärm und Lastempfindlichkeit

Referenzdrift zeigt sich als langfristige Verstärkungsschwankung und Referenzrauschen erscheint direkt als Umwandlungsrauschen.Ein subtileres Problem ist das dynamische Laden der Referenz: Einige ADCs ziehen während der Abtastung oder Umwandlung transiente Ströme aus der Referenz.Wenn die Referenzquelle oder ihr Entkopplungsnetzwerk diese Stromimpulse nicht sauber liefern kann, können zusätzliches Rauschen und Verzerrungen auftreten, deren Fehlerbehebung nach dem Einfrieren des Layouts zeitaufwändig ist.

Referenzverhalten im Listenstil, das häufig während der Validierung auftritt:

- Temperaturdrift und Langzeitalterung- Breitbandiges und niederfrequentes (1/f) Rauschen

- Dynamische Lastschritte während der Konvertierung

- Empfindlichkeit gegenüber der Impedanz der Referenzquelle und der Platzierung der Entkopplung

Einschränkungen der digitalen Schnittstelle: Der Durchsatz entsteht auf Systemebene

Das Ausgabeformat (parallel vs. seriell) ist mehr als eine Verkabelungspräferenz;Es wird ein Timing- und Durchsatzvertrag mit dem Prozessor oder FPGA geschlossen.Ein Konverter mit starker analoger Leistung kann immer noch zu wenig liefern, wenn die Schnittstelle und der Datenpfad die Daten nicht kontinuierlich und vorhersehbar übertragen können.

Serielle Schnittstellen (SPI, LVDS, JESD204 usw.)

Serielle Verbindungen reduzieren die Anzahl der Pins, führen jedoch zu Taktanforderungen, Latenz, Protokoll-Overhead und Jitter-Empfindlichkeit.Ein wiederkehrendes Stolpern auf Systemebene besteht darin, anzunehmen, dass die Schnittstellenbandbreite „gleich“ der ADC-Abtastrate ist, ohne Budget für Framing, Leseverzögerungen, Synchronisierung, Lane-Overhead und Software-/Firmware-Servicezeit einzuplanen.Dieses Missverhältnis zeigt sich meist erst spät, nämlich dann, wenn die Zeitpläne knapp sind und die Geduld am Ende ist, als irgendjemand zugeben möchte.

Überlegungen zur seriellen Schnittstelle im Listenstil, die die nachhaltige Erfassung häufig einschränken:

- Protokoll-Overhead und Framing-Effizienz- Ausleselatenz und Puffertiefe

- Anforderungen an Taktqualität, Jitter-Übertragung und Ausrichtung

- Firmware-/Treiber-Servicezeit und Planungsvariabilität

Prozessor-/FPGA-Budget und deterministisches Timing

Nachhaltiges Sampling wird oft durch DMA-Setup, Interrupt-Ratenobergrenzen, Speicherbandbreite, Cache-Effekte und Pufferstrategie eingeschränkt.Ein pragmatischer Auswahlschritt besteht darin, die Datenrate im ungünstigsten Fall (einschließlich Metadaten) zu berechnen und zu überprüfen, ob der gesamte Erfassungspfad diese kontinuierlich aufrechterhalten kann, und nicht nur in kurzen Bursts, die in einer kurzen Demo gut aussehen.

Leistungs-, Gehäuse-, PCB-Einschränkungen und Kosten-Leistungs-Kompromisse

Versorgungsgrenzen, Verlustleistung und Gehäusetyp beeinflussen das thermische Verhalten und das Layoutrisiko.Kleine Pakete sparen Platz, können jedoch die Routing-Dichte erhöhen, die Kopplungspfade erhöhen und eine disziplinierte Partitionierung erschweren.Bei vielen echten Platinen ist das zufriedenstellendste „Upgrade“ nicht ein Konverter mit höherer Auflösung, sondern eine Gehäusewahl, die eine sauberere Erdung, kürzere Referenzspuren und eine stärkere Trennung zwischen analogen und digitalen Bereichen ermöglicht – Veränderungen, die sich bei Rauschmessungen tendenziell deutlich bemerkbar machen.

Kosten und Leistung lassen sich am besten auf Systemebene bewerten.Ein kostengünstigerer ADC, der einen Präzisionspuffer, eine sauberere Referenz, eine strengere Filterung oder zusätzliche Leiterplattenschichten erfordert, kann am Ende mehr kosten als ein höherwertiger ADC, der die umgebenden Schaltkreise vereinfacht und die Integrationsunsicherheit verringert.

Praktische Auswahlstrategie (ein Entscheidungsrahmen, der der Prüfung standhält)

Eine zuverlässige Methode zur Auswahl eines ADC besteht darin, die Anforderungen in der folgenden Reihenfolge festzulegen und dabei Zahlen zu verwenden, die das Team messen und im Zuge der Weiterentwicklung des Designs erneut überprüfen kann:

Anforderungssperrreihenfolge

• Definieren Sie die kleinste bedeutsame Signaländerung und das tolerierbare Grundrauschen (dies informiert über effektive Auflösungsziele).

• Definieren Sie die maximale Signalbandbreite und Latenztoleranz (dies bestimmt die Abtastrate und die Architekturanpassung).

• Validieren Sie die Eingabelaufwerksfähigkeit und das Abrechnungsbudget (dies entscheidet oft darüber, ob Pufferung hinzugefügt wird).

• Wählen Sie einen Referenzansatz, der die Drift- und Geräuscherwartungen unter realen Streckenführungs- und thermischen Einschränkungen erfüllt.

• Stellen Sie sicher, dass die digitale Schnittstelle und der nachgeschaltete Datenpfad einen kontinuierlichen Durchsatz aufrechterhalten können.

• Verfeinern Sie die Auswahl von Gehäuse, Leistung und Kosten, sobald die oben genannten Einschränkungen gut zusammenpassen.

Diese Reihenfolge hilft, eine bekannte Falle zu vermeiden: Die Auswahl eines Konverters auf der Grundlage der Auflösung und der Hauptabtastrate und die späte Entdeckung, dass Referenzrauschen, Einschwinggrenzen oder Schnittstellen-Timing letztendlich die tatsächliche Obergrenze für die Systemleistung festlegen.

Fazit

Beim ADC-Design handelt es sich letztlich um ein technisches Problem auf Systemebene und nicht um eine einfache Komponentenauswahl.Die tatsächliche Konvertierungsqualität hängt davon ab, wie gut die gesamte Signalkette zusammenarbeitet, einschließlich des analogen Frontends, der Referenzschaltung, des Abtastnetzwerks, des Taktsystems, der digitalen Schnittstelle und der PCB-Implementierung.Verschiedene ADC-Architekturen wie Flash, SAR, Dual-Slope, Pipeline und Sigma-Delta lösen jeweils unterschiedliche Leistungsprioritäten, einschließlich Geschwindigkeit, Auflösung, Latenz, Bandbreite, Rauschunterdrückung und Stromverbrauch.In praktischen Anwendungen ist der beste ADC normalerweise derjenige, der dem tatsächlichen Signalverhalten, den Umgebungsbedingungen und den Langzeitstabilitätsanforderungen des Gesamtsystems entspricht, anstatt einfach nur die höchsten Spezifikationen auf dem Papier zu bieten.

Häufig gestellte Fragen [FAQ]

1. Warum bleibt die tatsächliche ADC-Leistung oft hinter den Auflösungsspezifikationen der Datenblätter zurück?

Die Auflösung des ADC-Datenblatts beschreibt nur die Anzahl möglicher digitaler Codes, nicht die tatsächliche Genauigkeit, die in einem funktionierenden System erreicht wird.Bei praktischer Hardware reduzieren Faktoren wie Referenzrauschen, Taktjitter, Front-End-Einschwingverhalten, PCB-Layout, Erdungsqualität und Einschränkungen des Eingangstreibers häufig die effektive Leistung des Wandlers.Wenn die Eingangsfrequenzen steigen, können Timing-Unsicherheit und analoge Verzerrungen den nutzbaren Dynamikbereich verbrauchen, lange bevor die theoretische Bittiefe erreicht ist.

2. Wie beeinflusst die Anti-Alias-Filterung die Gesamtgenauigkeit der ADC-Messung?

Die Anti-Aliasing-Filterung begrenzt unerwünschte Frequenzinhalte vor der Abtastung, sodass Out-of-Band-Signale nicht in das nutzbare Signalband zurückfallen.Sobald Aliasing auftritt, sind die resultierenden Artefakte mathematisch nicht mehr von gültigen Signaldaten zu unterscheiden.In der Praxis führt eine schwache Anti-Alias-Filterung häufig zu unerwarteten Störungen, Verzerrungen oder falschen Frequenzkomponenten, die während der Analyse legitim erscheinen.Das richtige Filterdesign ist daher für die Aufrechterhaltung zuverlässiger Messungen in Hochgeschwindigkeits-Datenerfassungssystemen von entscheidender Bedeutung.

3. Warum ist das Sample-and-Hold-Einschwingverhalten in hochauflösenden ADC-Systemen von entscheidender Bedeutung?

Der Sample-and-Hold-Schaltkreis muss das analoge Signal erfassen und dem Abtastkondensator ermöglichen, sich vollständig auszugleichen, bevor die Umwandlung beginnt.Wenn der Eingangstreiber oder die Quellenimpedanz den Kondensator nicht schnell genug aufladen kann, erzeugt der ADC voreingenommene Umwandlungsfehler und kein rein zufälliges Rauschen.Diese Einschwingprobleme werden bei höheren Eingangsfrequenzen oder beim Kanalmultiplexen schwerwiegender, wenn der Abtastkondensator wiederholt zwischen großen Spannungsunterschieden wechseln muss.

4. Wie begrenzt Aperturjitter die ADC-Leistung bei hohen Frequenzen?

Aperturjitter führt zu Unsicherheiten hinsichtlich des genauen Zeitpunkts des Abtastzeitpunkts.Wenn sich das Eingangssignal schnell ändert, führen selbst kleine Zeitfehler direkt zu Fehlern bei der Spannungsmessung.In Hochgeschwindigkeitssystemen wie Oszilloskopen, HF-Empfängern und softwaredefinierten Funkgeräten wird Taktjitter häufig zur dominanten Einschränkung der effektiven Auflösung und des Dynamikbereichs, selbst wenn der ADC selbst eine hohe nominale Bittiefe unterstützt.

5. Warum werden SAR-ADCs in modernen Mixed-Signal-Systemen häufig verwendet?

SAR-ADCs (Successive Approximation Register) bieten ein praktisches Gleichgewicht zwischen Geschwindigkeit, Auflösung, Energieeffizienz und Siliziumkomplexität.Sie verwenden einen binären Suchkonvertierungsprozess, der einen einzelnen Komparator und DAC wiederverwendet, anstatt massive parallele Hardware wie Flash-Konverter zu erfordern.Dadurch eignen sich SAR-ADCs hervorragend für eingebettete Systeme, industrielle Steuerungen, Instrumente und Sensorschnittstellen, bei denen sowohl eine mittlere bis hohe Auflösung als auch ein effizienter Stromverbrauch wichtig sind.

6. Was macht Flash-ADCs trotz ihrer Einschränkungen für extrem schnelle Anwendungen geeignet?

Flash-ADCs führen mithilfe großer Komparatorarrays alle Spannungsvergleiche gleichzeitig durch, sodass Konvertierungen extrem schnell und mit sehr geringer Latenz abgeschlossen werden können.Diese Architektur ist in Anwendungen wie Hochgeschwindigkeitskommunikationssystemen, Radar und Breitbandoszilloskopen äußerst effektiv.Allerdings wächst die Anzahl der Komparatoren exponentiell mit der Auflösung, wodurch der Stromverbrauch, die Siliziumfläche, die Eingangskapazität und die Komplexität der Kalibrierung steigen.

7. Warum bevorzugen Präzisionsmesssysteme häufig Dual-Slope-ADC-Architekturen?

Dual-Slope-ADCs wandeln Spannung durch Integrations- und Desintegrationsprozesse in Zeit um.Dadurch wird das Rauschen auf natürliche Weise gemittelt und periodische Störungen wie 50-Hz- oder 60-Hz-Netzbrummen werden stark unterdrückt.Aufgrund ihrer hervorragenden Langzeitstabilität und Rauschunterdrückung erfreuen sich Dual-Slope-Wandler in Präzisionsinstrumenten und Digitalmultimetern nach wie vor großer Beliebtheit, auch wenn ihre Wandlungsgeschwindigkeiten viel langsamer sind als bei modernen Architekturen mit hohem Durchsatz.

8. Wie wirken sich die Referenzspannungsqualität und das PCB-Layout direkt auf die ADC-Genauigkeit aus?

Die Referenzspannung definiert die Skalierung jedes digitalen Ausgangscodes, sodass Abweichungen, Rauschen oder Instabilitäten direkt in den Konvertierungsergebnissen angezeigt werden.Ein schlechtes PCB-Layout kann auch digitales Schaltrauschen in das Referenznetzwerk oder die analogen Erdungspfade einleiten und so die effektive Auflösung beeinträchtigen.In vielen Systemen verbessern sorgfältiges Routing, Entkopplung, Erdungsstrategie und Wärmemanagement die Messgenauigkeit mehr als nur die Aufrüstung des ADC selbst.

9. Warum ist ENOB in der praktischen ADC-Bewertung aussagekräftiger als die nominale Auflösung?

Die effektive Anzahl von Bits (ENOB) spiegelt die tatsächlich nutzbare Auflösung nach Berücksichtigung von thermischem Rauschen, Referenzinstabilität, Jitter, Quantisierungsrauschen und analogen Unvollkommenheiten wider.Ein Konverter bietet möglicherweise eine sehr hohe Nennauflösung an, aber reales Rauschen und Interferenzen verringern häufig die Anzahl der während des Betriebs verfügbaren zuverlässigen Bits.ENOB liefert daher einen realistischeren Hinweis auf die Messqualität in eingesetzten Systemen.

10. Warum sollten ADCs als Teil einer vollständigen Signalkette und nicht als isolierte Komponenten behandelt werden?

Die ADC-Leistung hängt stark von der Interaktion zwischen Wandler, Eingangstreiber, Anti-Alias-Filter, Referenzschaltung, Taktsystem, digitaler Schnittstelle und PCB-Layout ab.Selbst ein Hochleistungs-ADC kann zu schlechten Ergebnissen führen, wenn die umgebenden Schaltkreise Einschwingfehler, Referenzinstabilität, Kopplungsrauschen oder Zeitunsicherheit verursachen.Erfolgreiche Designs entstehen in der Regel dadurch, dass der gesamte Signalpfad gemeinsam optimiert wird, anstatt sich nur auf ADC-Spezifikationen zu konzentrieren.

Verwandter Blog

-

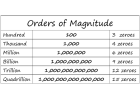

Wie viele Nullen in einer Million, Milliarden, Billionen?

2024/07/29

Millionen repräsentieren 106, eine leicht griffbare Figur im Vergleich zu alltäglichen Gegenständen oder jährlichen Gehältern. Milliarden, entspr... -

IRLZ44N MOSFET -Datenblatt, Schaltung, Äquivalent, Pinout

2024/08/28

Der IRLZ44N ist ein weit verbreiteter N-Kanal-Power-MOSFET.Es ist bekannt für seine hervorragenden Schaltkapazitäten und eignet sich sehr für zahlr... -

Batteriestemperatur zu niedrig, das Laden gestoppt.Wie repariere ich es?

2024/10/6

Das Ladeproblemen von Mobiltelefonen sind häufig, können jedoch effektiv verwaltet werden.Die Temperatur spielt eine große Rolle bei der Batterieff... -

BC547 Transistor umfassender Leitfaden

2024/07/4

Der BC547 -Transistor wird üblicherweise in einer Vielzahl elektronischer Anwendungen verwendet, die von grundlegenden Signalverstärkern bis hin zu ... -

Umfassende Anleitung zum SCR (Siliziumgesteuerte Gleichrichter)

2024/04/22

Siliziumkontrollierte Gleichrichter (SCR) oder Thyristoren spielen aufgrund ihrer Leistung und Zuverlässigkeit eine entscheidende Rolle in der Energi... -

LR621, SR621SW, 364, AG1 -Batterieäquivalente und Ersatz

2024/07/15

Die Batterien von LR621- und SR621SW -Tasten sind in kompakten elektronischen Geräten wie Uhren, kleinen Spielzeugen, Taschenrechnern und Fernschlüs... -

Grundlagen von Op-Ampere-Schaltungen

2023/12/28

In der komplizierten Welt der Elektronik führt uns eine Reise in ihre Geheimnisse ausnahmslos zu einem Kaleidoskop aus exquisiten und komplexen Schal... -

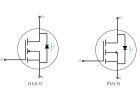

Vergleich der Unterschiede und Anwendungen von NMOs und PMOS

2024/11/15

Das Verständnis der Unterschiede zwischen NMOS- und PMOS -Transistoren ist wichtig für die Gestaltung effizienter Schaltkreise.NMOs (N-Type-Metallox... -

Ein vollständiger Leitfaden für Multiplexer und ihre Rolle in digitalen Systemen

2025/09/20

Multiplexer sind Komponenten in digitalen Systemen, mit denen mehrere Eingangssignale unter Verwendung binärer Logik- und Kontrollsignale in eine ein... -

Was bedeuten STD, AGM und Gel auf einem Batterieladegerät?

2024/07/10

Herkömmliche Ladegeräte für Blei-Säure-Batterien sind für ihre Einfachheit und Zuverlässigkeit bekannt.Sie dienen ihren Zweck seit Jahren effekt...

Heiße Teile

- TPS71733DCKR

- ATSAMD21J18A-MUT

- 12065A1R5BAT2A

- NJM2504RB1-TE1

- UCS81003AMR-C1A

- EMIF03-S1M01F1U8

- R5F100GEAFB#V0

- LPC1114FBD48/303

- TAP685M016SRS

- T491S475M010AT

- AT17LV256-10PI

- ATA2741M-TCQY

- 2SK1794

- GRM1886S1H7R9DZ01D

- T266SAB/Q

- DMC2700UDM-7

- TSC2046IPWR

- UPD65951S1-E32-F6

- BCM3451KMLG

- CC2564MODNCMOER

- XC2S200E-6FT256I

- EDB4432BBPA-1D-F-D

- T491D477K006AT

- S71PL032J40BAW0K0

- ICS952508BGLF

- C8051F352-GQR

- 08055A101GAT4A

- MC14584BFL1

- 06035C122JAT4A

- LTC1645IS8

- STM32L051T8Y6DTR

- AT9056-A3

- AD7574SQ

- C1608C0G1H750J

- AK4129VQ

- LTC6101HVACMS8#PBF

- MCF52223CAF80

- EPC2TI32N

- RC1206FR-07133KL

- 08053C562MAT2A

- BTS737S2

- T491B106K010AT4539

- K4S1616220-TC10

- QG82945GZ

- S29AL008D90BAI02

- BA7149F-T1

- PMEW2520

- S05071D1PZPRG4

- EM2280P01QI

- MB90F055PMC1-G-SNE1